Staatliche Stellen setzen zunehmend KI ein – auch bei Fragen zu Aufenthalt, Schutz oder Abschiebung. In den USA nutzt die ICE digitale Systeme zur Identitätsprüfung und Entscheidungsunterstützung. Das wirft Fragen nach Fairness, Kontrolle und Rechtsstaatlichkeit auf.

1. Der digitale Grenzbeamte – ein reales Beispiel

Als die US‑Behörde ICE (Immigration and Customs Enforcement) vor einigen Jahren ein Analysezentrum in Texas eröffnete, war eines der erklärten Ziele, „effektiver und schneller“ zu arbeiten, indem Daten aus unterschiedlichen Quellen zusammengeführt werden. Statt klassischer Ermittlungsarbeit nutzen Ermittler zunehmend Algorithmen, die aus Millionen von Datensätzen Muster erkennen sollen – von Reiseverläufen über Kommunikationsdaten bis zu sozialen Medien.

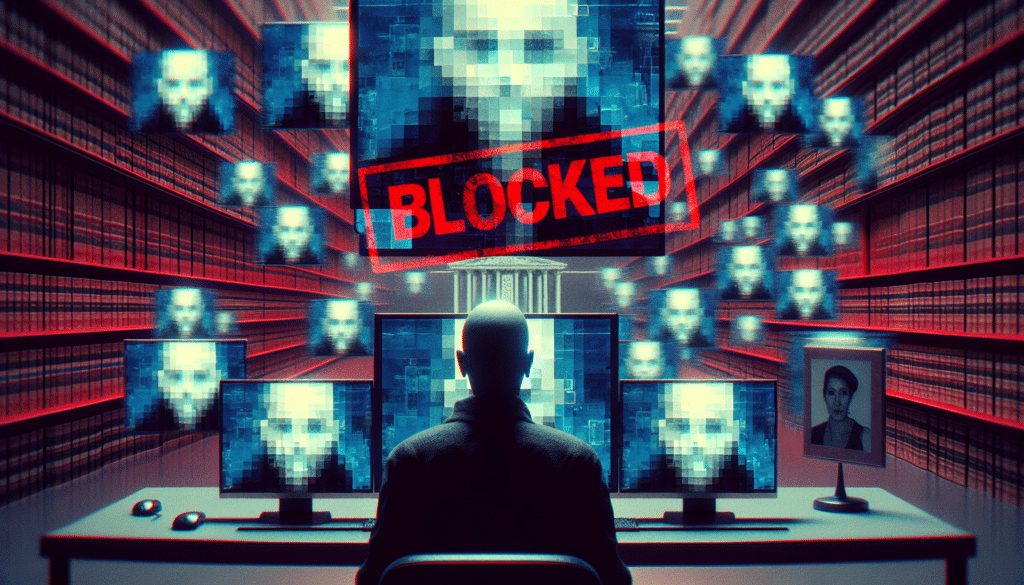

Ein Fall, der bundesweit für Aufsehen sorgte: ICE setzte Gesichtserkennung ein, um Menschen zu identifizieren, die keine gültigen Papiere hatten. Doch die Technologie war nicht nur auf Personen mit Migrationshintergrund beschränkt: Nach Berichten wurde sie auch gegen US‑Bürger*innen ohne deren Wissen angewandt. Senatoren und Senatorinnen des US‑Kongresses äußerten sich besorgt, weil dies verfassungsrechtliche Fragen zum Schutz der Privatsphäre aufwirft.

Damit wird sichtbar: KI‑Systeme sind kein abstraktes Zukunftsexperiment – sie werden konkret genutzt, und ihre Ergebnisse beeinflussen Menschenleben.

2. Digitale Werkzeuge im Behördeneinsatz

Der Begriff „KI“ wird hier oft als Sammelbegriff verwendet, doch gemeint sind ganz konkrete Technologien:

• Biometrische Systeme:

Gesichtserkennung, Fingerabdruckanalyse, automatische Identitätsvergleiche.

• Predictive Analytics:

Algorithmen, die Wahrscheinlichkeiten berechnen, z. B. ob jemand als „risikoreich“ gilt oder nicht.

• Netzwerkanalyse:

Verknüpfung von Datenpunkten wie Telefonkontakten, Aufenthaltsorten und Online‑Profilen.

Ein prominentes Beispiel ist Palantir Gotham, eine Plattform, die von ICE und anderen Behörden genutzt wird, um große Datenmengen zu analysieren. Solche Systeme wirken zunächst harmlos: Sie „unterstützen“ Ermittler. Doch wenn ihre Ergebnisse in Entscheidungsprozesse einfließen, die darüber entscheiden, ob jemand bleiben, ausreisen oder abgeschoben wird, wird ihre Rolle politisch und gesellschaftlich brisant.

3. Wenn Daten entscheiden: Bias, Diskriminierung und Black‑Box‑Effekte

Einer der größten Kritikpunkte an algorithmischen Systemen ist ihr inhärenter Bias. Das bedeutet: Systeme können Vorurteile reproduzieren oder verstärken, wenn ihre Trainingsdaten historische Ungleichheiten enthalten.

Studien zur Gesichtserkennung zeigen, dass viele Systeme bei der Identifikation von Menschen mit dunkler Hautfarbe oder Frauen deutlich schlechter abschneiden als bei hellhäutigen Männern. In einem bekannten Experiment lagen Fehlerquoten bei der Klassifikation von Hautfarbe und Geschlecht teils bei über 30 %, während sie bei hellhäutigen Männern unter 1 % lagen. In umfangreicheren Tests mit kommerziellen Algorithmen wiesen viele Modelle deutlich höhere Fehlinformationen für People of Color im Vergleich zu weißen Personen auf. Wenn solche Technologien in Grenz‑ und Kontrollkontexten eingesetzt werden, können ungleiche Erkennungsraten zu falschen Entscheidungen und damit zu einem Verlust von Rechten führen.

Hinzu kommt ein zweites Problem: Viele Systeme sind Black Boxes. Behörden nutzen proprietäre Software – also Programme, deren interne Logik nicht öffentlich einsehbar ist. Selbst wenn ein*e Asylbewerber*in einen Einspruch gegen eine Entscheidung einlegt, bleibt die Frage: Welche Datenbasis hatte der Algorithmus? Welche Regeln hat er angewendet? Jenseits von Schlagworten wie „KI“ und „Machine Learning“ bleibt die Grundlage oft verborgen.

4. Rechtslage – Zwischen Gesetzeslücken und Regulierung

Rechtlich bewegt sich der Einsatz von KI in der Migrationskontrolle auf unterschiedlichem Terrain:

USA

In den USA gibt es kein umfassendes nationales Datenschutzgesetz. Das bedeutet, Behörden dürfen Daten oft weitreichender nutzen als etwa in Europa. Initiativen wie der „Algorithmic Accountability Act“ befinden sich im Gesetzgebungsprozess, doch bisher ohne verbindliche Konsequenzen.

Zivilgesellschaftliche Organisationen wie die ACLU oder EFF bringen wiederholt rechtliche Beschwerden vor, doch gesicherte rechtliche Leitplanken fehlen bislang. Viele der eingesetzten Systeme werden nicht öffentlich überprüft.

EU

Die EU hat mit dem AI Act erstmals einen Rechtsrahmen geschaffen, der „Hochrisiko‑KI“ definiert. Systeme, die wesentliche Lebensbereiche berühren (z. B. Migration, Asyl) sollen strengen Prüfpflichten unterliegen:

✔ Dokumentationspflichten

✔ Transparenzverpflichtungen

✔ menschliche Kontrollinstanz

Doch dies gilt noch nicht überall. Frontex und andere Agenturen arbeiten in einem Spannungsfeld zwischen technischen Möglichkeiten und rechtlicher Kontrolle – denn der AI Act muss noch vollständig umgesetzt und überwacht werden.

5. Der Capgemini‑Fall: Unternehmen in der Verantwortung

Ein besonders aufschlussreicher Fall zeigt, dass der technologische Einsatz nicht nur staatliche Akteure betrifft: Anfang 2026 kündigte der französische IT‑Konzern Capgemini an, seine US‑Tochter zu verkaufen, nachdem Kritik an ihrer Zusammenarbeit mit ICE laut wurde. Die Tochterfirma hatte unter anderem „digitale Lokalisierungsdienste“ bereitgestellt, die zur Erfassung von Personen eingesetzt wurden.

Was wie ein technischer Vertrag klingt, ist in der Praxis ein ethisches Problem: Technologieunternehmen tragen Verantwortung dafür, wie ihre Systeme genutzt werden. Wenn ein Unternehmen einzelne Staaten beim Einsatz von Überwachungstechnologien unterstützt, muss es sich der politischen und gesellschaftlichen Debatte stellen. Der Rückzug Capgeminis zeigt, dass Digitalkonzerne nicht außerhalb gesellschaftlicher Normen agieren können – und dass der öffentliche Druck eine Rolle spielt.

6. Aha‑Moment: Was passiert, wenn KI kein Werkzeug bleibt

Ein entscheidender Punkt, der oft übersehen wird: KI ist kein neutraler Assistent. Sie entsteht aus Daten, die bereits gesellschaftliche Vorurteile enthalten, und wird eingesetzt in einem staatlichen Kontext, in dem Entscheidungen rechtsverbindlich sind.

💡 Ein Algorithmus trifft keine Entscheidungen – er berechnet Wahrscheinlichkeiten.

Doch was bedeutet das, wenn ein Bürokratieprozess sagt:

„Die Wahrscheinlichkeit ist zu hoch – Antrag abgelehnt“?

Das Ergebnis ist formal eine Entscheidung einer staatlichen Behörde – aber die Grundlage bleibt statistisch. Sobald Wahrscheinlichkeiten über Rechte entscheiden, befinden wir uns in einem Spannungsfeld zwischen Mathematik, Ethik und Rechtsstaat.

7. Internationale ethische Perspektiven

Nicht nur in den USA ist die Debatte relevant:

- Kanada prüft ähnliche Systeme im Grenzmanagement.

- Australien nutzt bereits automatisierte Mustererkennung bei Visaanträgen.

- EU‑Staaten diskutieren KI‑gestützte Überwachungssysteme an Außengrenzen.

Die Debatte ist global – und sie stellt zentrale Fragen:

✔ Wer kontrolliert die Technologie, wenn sie über Freiheit entscheidet?

✔ Wer haftet für Fehler, Diskriminierung, Datenmissbrauch?

✔ Wie stellen wir sicher, dass Rechte auch in automatisierten Systemen geschützt sind?

Dies sind keine abstrakten Fragen – sie betreffen konkrete politische Entscheidungen und gesellschaftliche Werte.

Ausblick: Verantwortung neu verhandeln

Die Debatte über KI an der Grenze ist global – und sie stellt zentrale Fragen:

Wer kontrolliert die Technologie, wenn sie über Freiheit entscheidet? Wer haftet für Fehler, Diskriminierung, Datenmissbrauch? Und wie stellen wir sicher, dass auch Schutzsuchende Rechte behalten – in einem System, das immer weniger transparent wird?

Antworten darauf dürfen wir nicht nur Algorithmen überlassen. Sie sind Aufgabe von Politik, Zivilgesellschaft – und uns allen.

Der Einsatz algorithmischer Systeme in der Migrationskontrolle ist kein technisches Randphänomen – er betrifft grundlegende Rechts- und Freiheitsfragen. Nur durch klar definierte Regeln, transparente Systeme und demokratische Kontrolle kann verhindert werden, dass Technologie über Menschenrechte entscheidet.