Seit dem 2. Februar 2025 gelten in Europa die ersten verbindlichen Regeln für den Einsatz von Künstlicher Intelligenz. Mit dem EU AI Act setzt die EU weltweit neue Maßstäbe für ethische KI, Transparenz und Sicherheit. Während Social Scoring und manipulative KI-Praktiken verboten werden, müssen Unternehmen hohe Anforderungen an Datensicherheit, Mitarbeiterschulung und Transparenz erfüllen. Doch welche konkreten Vorschriften gelten nun? Dieser Artikel liefert eine präzise Übersicht über die wichtigsten neuen KI-Regeln und deren Auswirkungen.

Am 2. Februar 2025 trat die europäische KI-Verordnung, bekannt als EU AI Act, in Kraft. Diese Regulierung markiert einen bedeutenden Schritt zur Schaffung eines rechtlichen Rahmens für den Umgang mit Künstlicher Intelligenz (KI) in Europa. Ziel ist es, eine Balance zwischen Innovation und Sicherheit zu schaffen. Die EU strebt mit diesem Gesetz an, Risiken zu minimieren und gleichzeitig ethische Standards zu wahren.

Der EU AI Act zielt darauf ab, die Rechte der Bürger*innen zu schützen und empfiehlt sich als globales Modell für KI-Regulierung. Die Motivation hinter diesem umfangreichen Regelwerk ist es, Vertrauen in KI-Systeme zu stärken und einen fairen Wettbewerb zu gewährleisten. Die Anforderungen betreffen sowohl Anbieter als auch Anwender von KI-Systemen. Die zentralen Anforderungen sind:

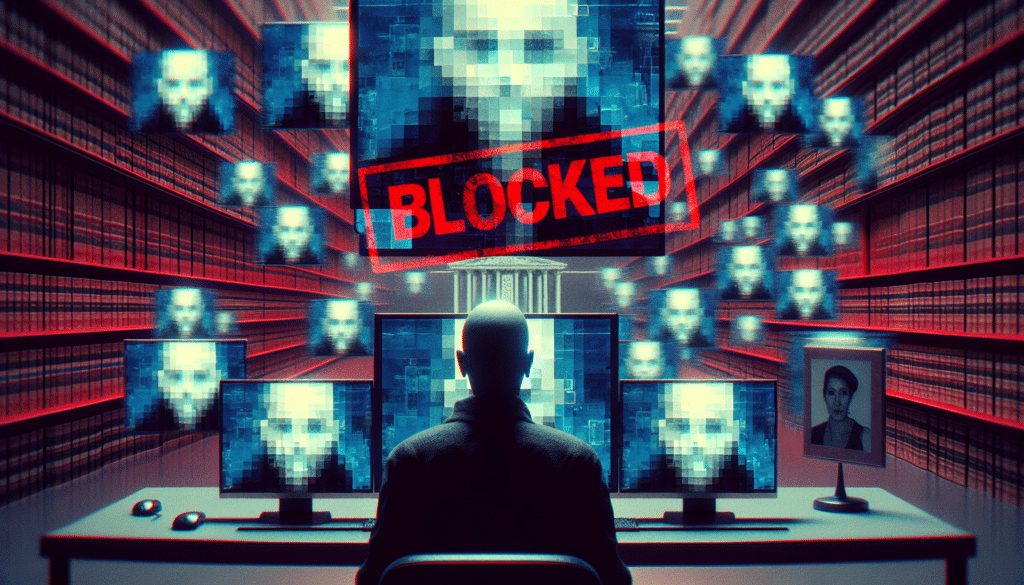

1. Verbot bestimmter KI-Praktiken

Der AI Act untersagt die Nutzung von KI-Systemen, die als unannehmbares Risiko gelten. Zu den verbotenen Praktiken gehören:

- Unterschwellige Beeinflussung und Manipulation: KI-Systeme, die durch unbewusste Techniken das Verhalten von Personen in einer Weise beeinflussen, die ihnen Schaden zufügen könnte.

- Ausnutzung von Schutzbedürftigkeit: Systeme, die die Schwächen bestimmter Personengruppen, wie Kinder oder Menschen mit Behinderungen, ausnutzen.

- Social Scoring: Bewertung der Vertrauenswürdigkeit von Personen anhand ihres Verhaltens oder persönlicher Merkmale durch staatliche Stellen.

- Predictive Policing: Vorhersage der Wahrscheinlichkeit, dass eine Person eine Straftat begehen wird.

- Unkontrollierte biometrische Überwachung: Einsatz von Echtzeit-Fernidentifizierungssystemen in öffentlich zugänglichen Räumen zu Strafverfolgungszwecken, mit bestimmten Ausnahmen.

Diese Verbote zielen darauf ab, die Grundrechte der Bürgerinnen und Bürger zu schützen und ethische Standards im Umgang mit KI zu gewährleisten.

2. Schulungspflicht für Mitarbeitende

Unternehmen, die KI-Systeme entwickeln oder einsetzen, sind verpflichtet sicherzustellen, dass ihre Mitarbeitenden über die notwendigen Kompetenzen im Umgang mit KI verfügen. Dies umfasst ein Verständnis für die Funktionsweise der Systeme, die Fähigkeit, Risiken zu erkennen, und das Wissen um rechtliche sowie ethische Vorgaben. Ziel ist es, einen verantwortungsvollen und sicheren Einsatz von KI-Technologien zu gewährleisten.

Diese Anforderungen treten bereits vor dem vollständigen Inkrafttreten des AI Acts in Kraft und erfordern von Unternehmen proaktive Maßnahmen zur Anpassung ihrer Prozesse und Schulungsprogramme.

Der EU AI Act als Chance und Herausforderung

Mit dem EU AI Act setzt Europa ein klares Zeichen für eine verantwortungsvolle und transparente Nutzung von Künstlicher Intelligenz. Die neuen Regelungen schaffen rechtliche Sicherheit, schützen Grundrechte und setzen hohe ethische Standards für den KI-Einsatz. Insbesondere das Verbot manipulativer KI-Praktiken, die strengeren Vorschriften zur Transparenz und die Verpflichtung zur Mitarbeiterschulung sind entscheidende Schritte, um Vertrauen in KI-Technologien zu stärken.

Gleichzeitig stellt der AI Act Unternehmen vor große Herausforderungen: Sie müssen ihre KI-Modelle überarbeiten, Compliance-Strukturen etablieren und neue Schulungskonzepte entwickeln. Doch genau hier liegt auch eine Chance: Unternehmen, die frühzeitig auf die neuen Vorgaben reagieren, können sich als Vorreiter im Bereich ethischer und sicherer KI positionieren – sowohl auf dem europäischen als auch auf dem globalen Markt.

Langfristig könnte der EU AI Act ein internationales Vorbild werden und die weltweite Regulierung von KI prägen. Entscheidend wird jedoch sein, ob die Regulierung flexibel genug bleibt, um mit den schnellen technologischen Fortschritten Schritt zu halten, ohne Innovation zu behindern.