Sie sind überall: große Augen, schrille Farben, perfektionierte Körper. Das Internet wird derzeit von einer Welle an KI-generierten Anime-Bildern überflutet – auf Plattformen wie Reddit, Pinterest, Lexica oder Civitai dominieren Manga- und Fantasy-Ästhetiken. Doch während Fans begeistert sind, stellen sich immer drängendere Fragen: Wem gehören diese Bilder? Wessen Kultur wird hier algorithmisch reproduziert? Und wie gerecht ist diese neue visuelle Welt eigentlich?

KI liebt Anime – aus System

Anime-Bilder wirken wie gemacht für generative KI: klar umrissene Linien, starke Kontraste, stilisierte Körperformen. Für Text-zu-Bild-Modelle wie Stable Diffusion, Midjourney oder DALL·E sind solche Ästhetiken technisch leichter zu reproduzieren als realistische Fotografie. Zudem existiert ein gigantischer Pool an Trainingsdaten – Fanart, Mangas, Cosplay-Fotos –, oft ohne klare Lizenzierung.

Besonders bei Open-Source-Modellen, etwa den beliebten Stable-Diffusion-Derivaten, wurden Datensätze häufig aus dem Netz gescraped – darunter auch urheberrechtlich geschütztes Material. Was als technische Bequemlichkeit begann, wird so zu einem juristischen und ethischen Minenfeld.

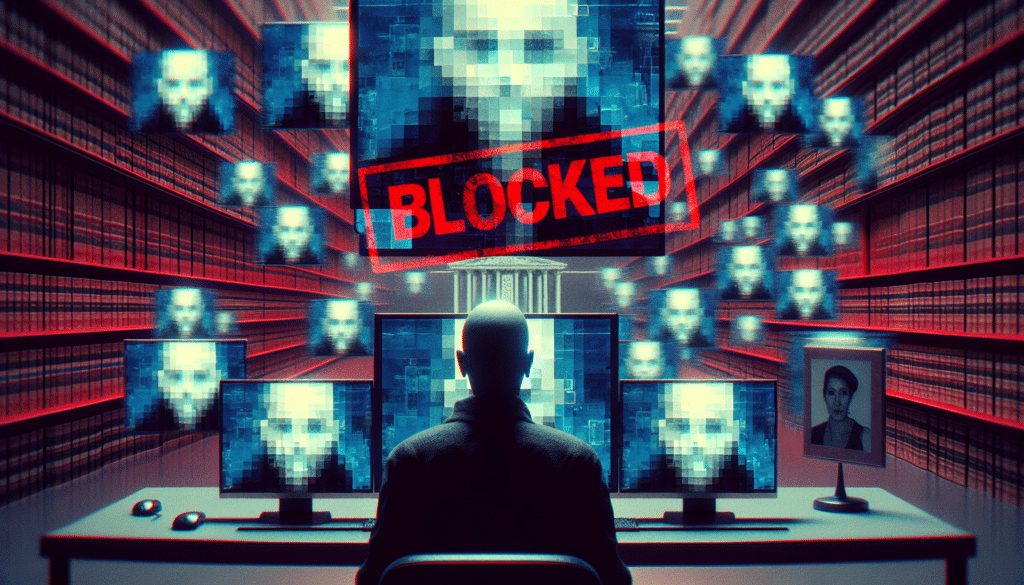

Urheberrecht in der Grauzone

„Wir befinden uns rechtlich im Niemandsland“, sagt eine Urheberrechtsjuristin der EU-Kommission in einem aktuellen Positionspapier. Zwar laufen erste Klagen – etwa von Illustrator*innen in den USA –, doch noch fehlt eine globale Linie. Während in Europa der AI Act versucht, Transparenz und Fairness zu fördern, sind Plattformen wie Civitai weitgehend unreguliert.

Ein Problem: Viele der beliebtesten Anime-Modelle wurden von Hobby-Entwicklern trainiert – oft ohne kommerzielle Absicht, aber auch ohne rechtliche Absicherung. Wer etwa mit dem populären AnyLoRA-Modell arbeitet, weiß selten, welche Originalwerke enthalten sind.

Kulturelle Dominanz durch Algorithmen

Neben den rechtlichen Fragen rückt zunehmend ein anderes Thema in den Fokus: kulturelle Einseitigkeit. Warum dominiert gerade die asiatische Anime-Ästhetik? Eine Ursache ist sicherlich die Beliebtheit der Stilrichtung – aber auch das Übergewicht entsprechender Trainingsdaten. Daraus ergeben sich neue Formen algorithmischer kultureller Dominanz: Wer heute „Fantasy Girl“ in ein KI-Modell eingibt, erhält fast immer hypersexualisierte Anime-Bilder – oft weiß, normschön und fern jeder Diversität.

Kritiker*innen sprechen von einer „Monokultur der KI-Kunst“ – einer Ästhetik, die Vielfalt unterdrückt und stereotype Darstellungen perpetuiert. Das sei nicht nur ein künstlerisches Problem, sondern auch ein ethisches, sagt der Medienethiker Prof. Yuki Nakamura: „Wenn KI-Modelle bestimmte Darstellungen bevorzugen, verstärken sie soziale Normen und Ausschlüsse.“

Reaktion der Plattformen: Noch verhalten

Einige Plattformen reagieren: Lexica kennzeichnet problematische Prompts, bei Hugging Face gibt es Modellkarten mit Herkunftsnachweisen. Doch diese Selbstregulierung ist oft lückenhaft. Und während große Modelle wie DALL·E restriktiver im Output sind, setzen viele User*innen lieber auf freiere (und rechtlich unsicherere) Open-Source-Alternativen.

Gerade deshalb fordern Expert*innen klarere Regeln: für Datentransparenz, Rechteklärung und kulturelle Fairness in KI-Modellen. Auch künstlerische Vielfalt sollte gefördert werden – etwa durch gezieltes Fine-Tuning auf diversere Datenbestände.

Ein Zwischenfazit: Wer bestimmt die KI-Ästhetik der Zukunft?

Die Diskussion über KI-generierte Anime-Bilder ist mehr als ein Nischenthema. Sie berührt Grundfragen des digitalen Zeitalters: Wem gehört Kreativität? Wer gestaltet die kulturellen Codes von morgen – Algorithmen oder Menschen? Und wie können wir rechtlich und ethisch mit diesen Veränderungen umgehen?

Derzeit steht das Internet im Bann einer visuellen Strömung, die technikgetrieben, datenbasiert – und kulturell nicht neutral ist. Höchste Zeit, dass Recht, Ethik und Gesellschaft darauf Antworten finden.